Как работают предложения автозаполнения Google Instant

- Google и предложения поиска

- Предложения на основе реальных поисков

- Предложения могут варьироваться в зависимости от региона и языка

- Ранее найденные предложения

- Как ранжируются предложения

- Дедупликация и правописание

- Вопросы свежести

- Почему и как предложения удаляются

- Ненависть и защищенные группы

- Судебные дела и удаления

- Спорные случаи

- Национальности кратко защищены; Религии нет

- Вы можете запросить удаление?

- Как насчет пиратства?

- И поддельные запросы?

- Предложение для предложений Google

Это хорошо известная особенность Google. Начните вводить в поиске, и Google предлагает предложения, прежде чем вы даже закончили вводить. Но как Google приходит с этими предложениями? Когда Google удаляет некоторые предложения? Когда Google решает не вмешиваться? Приходите за ответами.

Google и предложения поиска

Google не была первой поисковой системой, предлагающей поисковые предложения, и не единственной. Но, будучи самой популярной поисковой системой, многие стали более внимательно относиться к предложениям Google.

Google предлагает «Google Suggest» или « Автозаполнение ”На веб-сайте Google с 2008 года (и в качестве экспериментальной функции назад с 2004 года ). Поэтому предложения - или «прогнозы», как их называет Google, - не новы.

То, что Google предлагает для поисков, получило новое внимание после Google Instant Search был запущен в прошлом году. Google Instant - это функция, которая автоматически загружает результаты и изменяет их. Эта интерактивность побудила многих взглянуть на предложения, включая попытку перечислить все заблокированные предложения ,

Предложения на основе реальных поисков

Все предложения, которые предлагает Google, исходят от того, как люди на самом деле ищут. Например, введите слово «купоны», и Google предлагает:

- купоны для Walmart

- купоны онлайн

- купоны для цели

- купоны на узелки страшной фермы

Это все реальные поиски, которые были сделаны другими людьми. Популярность - фактор того, что показывает Google. Если много людей, которые начинают вводить «купоны», затем вводят «купоны для Walmart», это может помочь сделать «купоны для Walmart» в качестве предложения.

Google говорит, что другие факторы также используются, чтобы определить, что показать за пределами популярности. Однако все, что предлагается, является результатом реальной поисковой активности пользователей Google, заявляет компания.

Предложения могут варьироваться в зависимости от региона и языка

Не все видят одинаковые предложения. Например, выше в списке «купоны на страшную ферму узлов». Я вижу это, потому что я живу рядом с парком развлечений Knott's Berry Farm в округе Ориндж, штат Калифорния, где каждый год проводится популярное мероприятие «Страшная ферма Нотта».

Если я вручную изменю свое местоположение, чтобы сообщить Google, что я нахожусь в Де-Мойне, штат Айова, это конкретное предложение исчезнет и будет заменено на «купоны на лучшую покупку».

Точно так же, если я пойду к Google Великобритания Я получаю предложения, как:

- купоны великобритании

- купоны и ваучеры

- купоны для Tesco

Tesco - крупная британская сеть супермаркетов, лишь одно из проявлений того, насколько локализованы эти предложения.

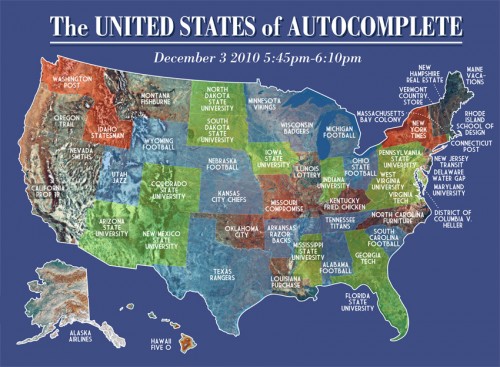

Это также почему-то вроде Google Instant Alphabet или же Соединенные Штаты Автозаполнения (показано ниже) - хотя и умно - не точны и никогда не могут быть, если вы говорите о предложениях, показанных в конкретном регионе.

Короче говоря, местоположение важно. Страна, в которой вы находитесь, штат или провинция, даже город, могут выдвигать разные предложения.

Язык также оказывает влияние. Если вы скажете Google, что предпочитаете выполнять поиск на определенном языке или на том языке, который, как предполагает Google, вы используете, будут появляться другие предложения, как это определено настройками вашего браузера.

Ранее найденные предложения

Предложения Google могут также содержать то, что вы искали раньше, если вы используете Функция веб-истории Google ,

Например, когда я ищу «ролик», мои предложения выглядят так:

Например, когда я ищу «ролик», мои предложения выглядят так:

- роликовые коньки

- Роликовый конь 2009 Speedmachine 110

- роликовые коньки

- колеса на роликах

- Rollerblade

Первые два взяты из моей истории поиска. Вот почему у них есть маленькая опция «Удалить» рядом с ними.

Персональное предложение, подобное этому, было предложено с мая 2009 года , Единственное изменение в Google Instant заключалось в том, что они были сделаны по-другому, они показаны фиолетовым цветом, как ссылки на некоторых веб-сайтах, чтобы указать, нажимали ли вы на них раньше.

Как ранжируются предложения

Как ранжируются показанные предложения? Перечислены ли более популярные поисковые запросы над другими? Нет.

Популярность является фактором, но некоторые менее популярные поисковые запросы могут показываться над более популярными, если Google считает их более актуальными, заявляет компания. Персонализированные поиски всегда будут выше других.

Дедупликация и правописание

По словам Google, в окончательных предложениях есть небольшая степень дедупликации и исправления орфографии.

По словам Google, в окончательных предложениях есть небольшая степень дедупликации и исправления орфографии.

Например, если некоторые люди вводят слово «LadyGaga» одним словом, все эти поиски по-прежнему влияют на предложение «Lady Gaga» - и предлагается в виде двух слов.

Точно так же слова, которые должны иметь пунктуацию, могут быть объединены. Наберите «ben and je…», и вам будет предложено «ben and jerry's», даже если многие люди откажутся от апострофа.

Вопросы свежести

У Google Autocomplete также есть то, что компания называет «слоем свежести». Если есть термины, которые внезапно набирают популярность в краткосрочной перспективе, они могут появиться в качестве подсказок, даже если они не приобрели долгосрочной популярности.

У Google Autocomplete также есть то, что компания называет «слоем свежести». Если есть термины, которые внезапно набирают популярность в краткосрочной перспективе, они могут появиться в качестве подсказок, даже если они не приобрели долгосрочной популярности.

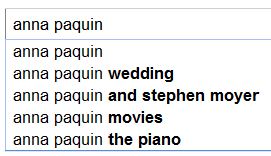

Хороший пример тому - когда актриса Анна Пакен вышла замуж. По словам Google, «свадьба Анны Пакуин» начала появляться как предложение как раз перед ее большим днем. Это было полезно предложить, потому что многие люди начали искать это.

Если бы Google полагался исключительно на долгосрочные данные, то предложение бы этого не сделало. И сегодня он больше не появляется, так как он не поддерживал многолетнюю популярность (хотя «анна пахин вышла замуж» застряла).

Насколько краткосрочным является краткосрочный? Google не будет вдаваться в подробности. Но предложения были замечены, появляясь в течение нескольких часов после того, как какая-то поисковая тенденция взлетела.

Почему и как предложения удаляются

Как я уже говорил ранее, прогнозы Google предлагались годами, но когда они были объединены с Google Instant, это вызвало новый интерес к тому, что было предложено, а что нет. Были вещи удалены?

Да, и по этим конкретным причинам Google говорит:

- Предложения, связанные с ненавистью или насилием

- Личная информация в предложениях

- Порно и взрослое содержание связанные предложения

- Юридически санкционированные удаления

- Предложения, связанные с пиратством

По словам компании, автоматические фильтры могут использоваться для блокирования любых предложений, противоречащих политикам и рекомендациям Google. Например, фильтры работают, чтобы не показывать такие вещи, как телефонные номера и номера социального страхования.

Так как фильтры не идеальны, некоторые предложения могут быть отклонены для проверки человеком, говорит Google.

Ненависть и защищенные группы

С точки зрения блокирования предложений ненависти и насилия, дело не в том, что все возможное ненависть блокируется как предложение.

С точки зрения блокирования предложений ненависти и насилия, дело не в том, что все возможное ненависть блокируется как предложение.

Например, «я ненавижу свою маму» и «я ненавижу своего папу» - оба предложения, которые появляются, если вы напишите «я ненавижу свою». Аналогичным образом, «ненавижу гл» вызывает оба слова: «ненавижу лишний» и «ненавижу гленн бек» «.

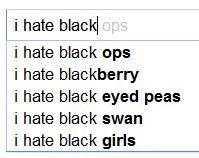

Вместо этого предложения ненависти удаляются, если они против «защищенной» группы. Так что же такое защищенная группа?

Google фактически не определяет это в своей помощи автозаполнения страница , Тем не менее, справка Google AdWords страница имеет краткое изложение того, что Google давно считается защищенными группами:

Google фактически не определяет это в своей помощи автозаполнения страница , Тем не менее, справка Google AdWords страница имеет краткое изложение того, что Google давно считается защищенными группами:

- раса или этническое происхождение

- цвет

- национальное происхождение

- религия

- инвалидность

- секс

- возраст

- Статус ветерана

- сексуальная ориентация или гендерная идентичность

Даже «большинство» групп, таких как белые, покрываются этим в категории «цвет». Похоже, именно поэтому «я ненавижу белых» не предлагает «я ненавижу белых», так же как «я ненавижу черных» не предлагает «я ненавижу черных».

Тем не менее, в обоих случаях другие ссылки на ненависть проходят (появляются «я ненавижу белых девушек» и «я ненавижу черных девушек»). Это где человеческий обзор может произойти, если ссылка замечена.

Судебные дела и удаления

Google блокирует некоторые предложения по юридическим причинам. Например, в прошлом году Google проиграл во Франции два дела, связанных с автозаполнением Google.

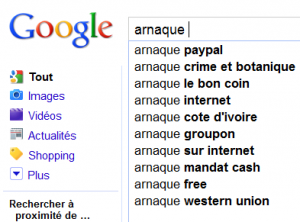

Во-первых Google было приказано убрать слово «arnaque», что означает мошенничество, из предложения, когда кто-то вводил название компании по дистанционному обучению.

Во-первых Google было приказано убрать слово «arnaque», что означает мошенничество, из предложения, когда кто-то вводил название компании по дистанционному обучению.

Google, кажется, сделал это, когда я проверил сегодня. Google не сказал бы, обжалует ли это дело, или это относится к предотвращению появления слова «арнак» рядом с названием любой компании.

Из некоторого ограниченного тестирования, я думаю, что Google препятствует тому, чтобы «arnaque» появлялся после названия любой компании, но не раньше («arnaque paypay» и «arnaque groupon» - это предложения).

в второй французский автозаполнение дела истец, осуждение которого было обжаловано, подал в суд и выиграл символическую выплату в размере 1 евро в качестве компенсации за появление слов «насильник» и «сатанист» рядом с его именем.

Имя плантифа не было дано в этом случае , поэтому я не могу проверить, что условия были удалены в соответствии с заказом. В прошлом году Google заявил, что обжалует это решение. Когда я попросил эту статью, компания не дала мне никаких новостей. Кажется маловероятным, что это привело к отказу Google от появления таких терминов рядом с именами других людей.

Вчера появились новости о Google теряет дело в Италии с предложениями , Здесь мужчина подал в суд на то, что рядом с его именем появились итальянские слова «обманщик» и «мошенничество».

Я не могу проверить, выполнил ли Google это постановление, потому что имя этого человека никогда не называлось, равно как и его адвокат очищать r если Google выполнил. Также неясно, вызывает ли это постановление такие термины в отношении чьего-либо имени (это кажется маловероятным).

Я спросил Google об этом, но мне дали только стандартное заявление:

Мы разочарованы решением Миланского суда. Мы считаем, что Google не должен нести ответственность за термины, появляющиеся в Автозаполнении, так как они предсказываются компьютерными алгоритмами, основанными на поиске предыдущих пользователей, а не самим Google. В настоящее время мы рассматриваем наши варианты.

В США Google победил случай, который в прошлом месяце вел женщина, недовольная тем, что слова «левитра» и «сиалис» появились рядом с ее именем. В этом случае во многом были споры о коммерческом нарушении, а не позиция клеветы.

Постскриптум: у Шона Карлоса из Antezeta есть больше о деле Милана Вот ,

Спорные случаи

Помимо судебных дел, предложения Google иногда превращаются в споры в новостях. Как правило, Google отвечает на них стандартным ответом, который выглядит следующим образом: прогнозы основаны на том, как люди ищут, а не на какой-то конкретной «повестке дня», которую компания пытается подтолкнуть.

Помимо судебных дел, предложения Google иногда превращаются в споры в новостях. Как правило, Google отвечает на них стандартным ответом, который выглядит следующим образом: прогнозы основаны на том, как люди ищут, а не на какой-то конкретной «повестке дня», которую компания пытается подтолкнуть.

Google говорит мне, что обычно не комментирует больше в этих случаях, потому что он не хочет иметь возможность выдавать подробный ответ на любую странность, которую кто-то замечает. Тем не менее, Google раскрыл два примера странных предложений, появившихся в прошлом.

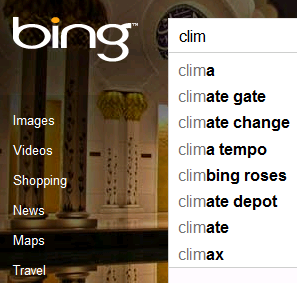

Одна из них была связана с предложением «климатгейт», который странным образом исчез вскоре после появления. мой Climategate: насколько он популярен, по мнению Google? история с декабря 2009 года имеет больше об этом.

Одна из них была связана с предложением «климатгейт», который странным образом исчез вскоре после появления. мой Climategate: насколько он популярен, по мнению Google? история с декабря 2009 года имеет больше об этом.

Во всем виноват упомянутый слой свежести, пишет Google. Когда все это происходило, слой свежести имел разрыв, который позволял всплывать запросам в течение короткого периода времени, а затем исчезать, если они не приобрели более длительную популярность.

Этот разрыв с тех пор был сокращен. Всплывающие запросы остаются дольше, а затем сбрасываются, если они не набирают длительную силу. Предложение «Климатгейт» не завоевало популярность и исчезло. Это не было удалено вручную, как некоторые предполагали, Google сказал.

Интересно отметить, что, глядя на сегодняшний день, «климатгейт» все еще не набрал достаточно длительной популярности, чтобы выступить в качестве предложения в Google. Но в Bing - который, конечно, использует свою собственную уникальную систему предложений - он предлагается.

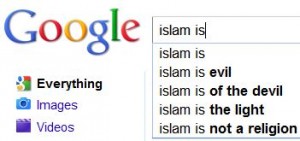

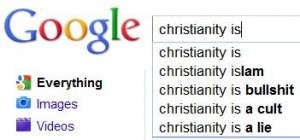

В другом случае поиск «ислам есть» не дал никаких предложений, в то время как поиск других религий был, в том числе и отрицательных. наш Ислам ... заблокирован "ошибкой" в Google Suggest История с января 2010 года имеет больше об этом.

В другом случае поиск «ислам есть» не дал никаких предложений, в то время как поиск других религий был, в том числе и отрицательных. наш Ислам ... заблокирован "ошибкой" в Google Suggest История с января 2010 года имеет больше об этом.

Как оказалось, произошла человеческая ошибка, сказал мне Google.

Эти предложения были рассмотрены человеком и, возможно, связаны с ненавистью. Блок был помещен, потому что кто-то предположил, что ислам как религия отвечает критериям защищенной группы.

Эти предложения были рассмотрены человеком и, возможно, связаны с ненавистью. Блок был помещен, потому что кто-то предположил, что ислам как религия отвечает критериям защищенной группы.

Но на самом деле Google Autocomplete не считает религии защищенными группами (я вернусь к этому). Таким образом, у других религий не было фильтра, установленного для них.

Сегодня «Ислам есть» возвращает некоторые негативные предложения, как и в случае с другими религиями.

Национальности кратко защищены; Религии нет

Чувствуете смущение по поводу того, кого защищать, на данный момент? Я тоже.

Чувствуете смущение по поводу того, кого защищать, на данный момент? Я тоже.

Помните, когда я перечислял, что защищенная группа была, согласно Google, выше? Это включало религии, но это определение, которое использует Google AdWords, а не Google Autocomplete.

Точно так же у YouTube Google есть свой определение защищенных групп:

Защищенные группы включают расу или этническое происхождение, религию, инвалидность, пол, возраст, статус ветерана и сексуальную ориентацию / гендерную идентичность.

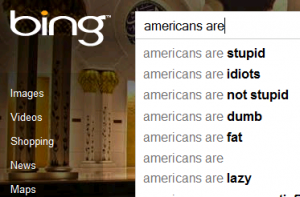

Национальное происхождение не в этом списке. Действительно, он не был в неопубликованном списке, который Google Autocomplete использует до мая прошлого года, когда Google начал фильтровать предложения, связанные с национальностью , Ищите «американцы», например, и вы ничего не получите.

Для меня это отчасти безумие. Зачем защищать национальности, а не религии? И почему бы предложения типа «евреи дешевы» или «евреи расисты» не рассматривались против защищенной группы, с точки зрения расы или этнической группы?

Для меня это отчасти безумие. Зачем защищать национальности, а не религии? И почему бы предложения типа «евреи дешевы» или «евреи расисты» не рассматривались против защищенной группы, с точки зрения расы или этнической группы?

Google дал мне это утверждение по теме (в скобках я не убираю слова, а вместо того, как Google указывает поисковый запрос):

Проще говоря, национальности относятся к отдельным лицам, а религии - нет. Наша политика ненависти предназначена для удаления контента, предназначенного для определенных групп людей. Таким образом, [исламисты есть] и [евреи есть] или [белые] могут быть отфильтрованы, в то время как такие запросы, как [ислам есть] и [иудаизм есть] не будут, потому что предложения направлены на других лиц, а не людей.

Извините, меня это не убеждает. Хуже того, когда я сегодня провел двойную проверку, ранее установленный фильтр национальности, который защищает это заявление, кажется, отключен. Да, американцы снова толстые, ленивые и невежественные, как предполагают «предсказания» Google, а французы ленивые трусы.

Вы можете запросить удаление?

Как вы можете себе представить, некоторые люди хотели бы удалить негативные предложения. Однако, как было объяснено, Google делает это только в очень конкретных случаях. Компания даже не имеет формы, чтобы запросить это (хотя есть страница справки на тему, которая предлагает оставлять комментарии в поддержке Google форумы ).

Следует ли разрешить предприятиям запрашивать удаление предложений? Это не то, что Google хочет арбитраж. Джонатан Эффрат, менеджер по продуктам Google, работающий в Google Instant, сказал мне:

К сожалению, мы не будем делать удаление в таких ситуациях. Много раз люди ищут его, и есть законная причина. У меня был друг, который раньше работал в компании, и название компании плюс «отстой» было предложением, и это было реальностью. Это не наше место, чтобы сказать, что вы не должны искать это.

Есть признаки того, что Google отступил, предложив «мошенничество» вместе с названиями компаний, но, несмотря на это отчеты Вы все еще можете найти примеры, где это все еще происходит. Кстати, Google не прокомментировал, если он действительно что-то изменил.

Как насчет пиратства?

Конечно, Google недавно решил, что люди не должны искать что-то, в случае онлайн-пиратства, когда это началось условия блокирования пиратства в январе ,

Конечно, Google недавно решил, что люди не должны искать что-то, в случае онлайн-пиратства, когда это началось условия блокирования пиратства в январе ,

Это исключило и продолжает вносить предложения по некоторым сайтам, которые также могут быть использованы по законным причинам. Чтобы было понятно, предложения были удалены, а не сами сайты.

Хотите читать файлы Wikileaks напрямую? BitTorrent или Utorrent имеют программное обеспечение, которое будет разрешаю тебе сделать это. Но сегодня Google не будет автоматически предлагать их имена, когда вы начнете печатать, считая их слишком пиратскими.

Помимо уничтожения некоторых потенциально невинных сторон, все это кажется немного лицемерным. Почему Google считает, что для защиты предложений поисковых систем, связанных с пиратством, необходимо делать все возможное, если существует целый ряд других потенциально опасных программ?

Ответ, на мой взгляд, заключается в том, что это пиар-битва, которую Google хочет выиграть, поскольку студии и сети обвиняют ее в поддержке пиратства и стремиться заручиться помощью Конгресса США. Отказ от пиратских предложений - это легкий подарок, особенно когда Google не занимается упреждающим устранением реальной проблемы, сайтов, на которых размещается пиратский контент в собственных результатах. Это также подарок, который может помочь ему получить блокировка сети Google TV поднял.

И поддельные запросы?

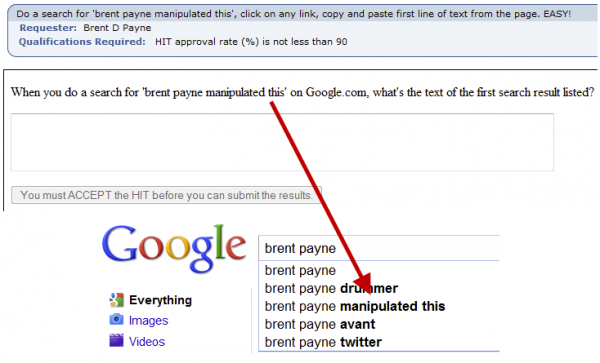

Между тем, новый вопрос привлек новое внимание - способность людей «выдвигать» предложения. В частности, Amazon's Mechanical Turk - это известное место, где люди могут попросить других сделать поиск. Когда происходит достаточное количество поисков, появляются предложения.

Брент Пэйн, вероятно, является одним из наиболее заметных примеров того, как кто-то сознательно делает это, так сказать, «за пределами радара». Он побежал серии экспериментов, в которых он нанял людей на Mechanical Turk для поиска, которые (пока Google не удалил их) вызвали появление предложений:

Соблазн попробовать? Помимо возможного нарушения условий Механического Турка, Google говорит, что это то, что она считает спамом и примет корректирующие меры против, если будет обнаружено.

Какое действие? Пока что это, похоже, ограничивается удалением готовых предложений.

Постскриптум: исследование Пейна, по-видимому, прошло, но другой Исследование, проведенное в марте 2012 года, показало, что использование Mechanical Turk все еще может оказать влияние.

Предложение для предложений Google

Как я уже сказал, Google Instant вновь обратил внимание на предложения Google - наряду с дискуссиями о том, должен ли Google предлагать предложения вообще, учитывая кошмар репутации, который они могут принести некоторым компаниям и отдельным лицам, а также оскорбление, которое они приносят другим группам. С другой стороны, есть их полезность.

Вот случай, который иллюстрирует балансирование. В прошлом году со мной связалась парашютистская компания, обеспокоенная тем, что при поиске ее имени возникло предположение о ее названии плюс слова «смерть» или «несчастный случай». Да, в компании был кто-то, кто погиб в прыжке.

Это что-то вредное для компании, даже если это правда. Прыжки с парашютом по своей природе являются чрезвычайно опасным видом спорта, и предложение не дает никаких указаний о том, была ли компания как-то виновата. Это сразу говорит о том, что с компанией что-то не так.

Однако это также невероятно полезно для поисковиков, так как они могут уточнить свои запросы так, как они этого не ожидают.

Тем не менее, я думаю, что балансирование должно склоняться к тому, чтобы не предлагать ничего негативного о каком-либо человеке, компании или группе. Никакой ерунды об «защищенных группах». Просто убейте негативные предложения, точка.

Тем не менее, я думаю, что балансирование должно склоняться к тому, чтобы не предлагать ничего негативного о каком-либо человеке, компании или группе. Никакой ерунды об «защищенных группах». Просто убейте негативные предложения, точка.

Кстати, это предложение для всех основных поисковых систем. Достаточно выделить Google, когда такие примеры можно легко найти на Bing и Yahoo.

Если есть какие-то негативные вещи, которые люди хотят узнать о человеке, компании или группе, они сами появятся в результатах поиска и смешаются с общим контекстом - хорошим, плохим или, возможно, безразличным.

Да, многие американцы знают, что они стереотипно воспринимаются как толстые. Другие национальности и религиозные группы также знают, что в них много вредных стереотипов. Но кто хочет, чтобы Google как будто сказал им это?

Да, Google правильно сказал, что предложения, которые он показывает, отражают то, что ищут многие люди - и, следовательно, думают.

Тем не менее, попугай вредных мыслей, «искал» других, не делает эти вещи менее вредными или вредными. И повторяя эти вещи, есть аргумент, что поисковые системы просто ухудшают ситуацию.

Как насчет пиратства?

И поддельные запросы?

Но как Google приходит с этими предложениями?

Когда Google удаляет некоторые предложения?

Когда Google решает не вмешиваться?

Перечислены ли более популярные поисковые запросы над другими?

Насколько краткосрочным является краткосрочный?

Были вещи удалены?

Так что же такое защищенная группа?

Мой Climategate: насколько он популярен, по мнению Google?